Sri Rampai, Wangsa Maju

Kuala Lumpur, Malaysia

adyaakob@gmail.com

+60 102369037

Sri Rampai, Wangsa Maju

Kuala Lumpur, Malaysia

adyaakob@gmail.com

+60 102369037

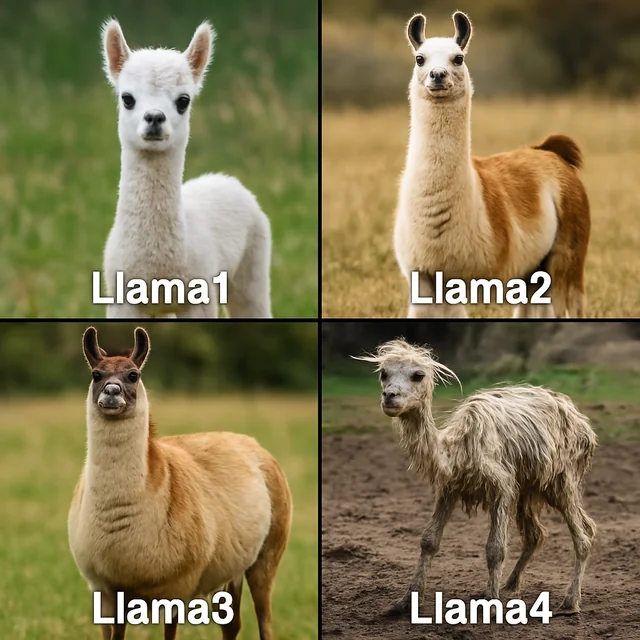

Llama 4, model AI terbaru dari Meta, dilancarkan pada 5 April 2025 dengan janji besar: multimodal natively, context window sehingga 10 juta token, dan prestasi tinggi. Tapi adakah ia benar-benar revolusioner atau sekadar hype? Komuniti Reddit dan YouTube mula membongkar realiti prestasi sebenar Llama 4 – ada yang kagum, tapi ramai juga kecewa. Artikel ini menggabungkan reaksi komuniti secara ringkas dan mudah difahami untuk membantu developers, tech bloggers, dan pembuat keputusan menilai kekuatan dan kekurangannya.

Llama 4 hadir dalam tiga varian utama:

✅ Llama 4 Scout: 109B total parameter, 17B aktif, 16 pakar, 10 juta context window, ~200 TPS. +30% laju dari Llama 3.

✅ Llama 4 Maverick: 400B parameter, 17B aktif, 128 pakar, 1 juta context window.

✅ Llama 4 Behemoth: Masih belum dilancarkan – 2T parameter, 288B aktif, 16 pakar. Dijangka jadi “teacher model” terbaik untuk distillation.

Semua model ini menyokong multimodal (teks, imej, video) secara native, bukan ditampal kemudian.

✅ Context Window Besar: Scout boleh proses sehingga 10 juta token, jauh lebih tinggi dari Gemini (2 juta).

✅ Multimodal Native: Tiada perlu sambungan model luar, semuanya digabungkan.

✅ Mixture of Experts (MoE): Input hanya dihantar kepada pakar berkaitan, jimat memori dan masa.

✅ QAT (Quantization-aware Training): Jimat 40% memori tanpa kurangkan ketepatan.

✅ Digunakan Secara Nyata: Kini kuasakan Meta AI di WhatsApp, Messenger dan Instagram (40 negara).

✅ Llama 4 sahkan industri bergerak ke arah MoE.

✅ Latihan dilakukan dengan context sehingga 256K token sebelum diperluas.

✅ Post-training guna gabungan SFT, RL dan DPO.

✅ Komuniti menantikan versi Reasoning dan Behemoth yang mungkin selesaikan kekurangan semasa.

✅ Prestasi Dunia Nyata Tidak Seperti Diiklankan: 20–25% lebih rendah berbanding benchmark rasmi.

✅ Lemah dalam Coding dan Reasoning: AiKing gelar prestasi coding “atrociously bad”.

✅ Perlu VRAM Tinggi: Scout perlukan 50GB VRAM. GPU biasa seperti RTX 4090 pun tak cukup efisien.

✅ Model Berat dan Lambat: Maverick dengan 400B parameter ada isu latency.

✅ Tiada Audio Support: Ketinggalan berbanding GPT-4o.

✅ Verbosity & Hallucination: Jawapan panjang meleret dan kadang-kadang pelik.

✅ Pesaing Lebih Mantap: QwQ-32b dan Gemma 3 outperform Llama 4 walaupun lebih kecil.

Ada spekulasi Meta sengaja optimakan Llama 4 untuk benchmark sahaja, bukan untuk aplikasi sebenar. Mungkin untuk naikkan permintaan Behemoth atau pikat pelabur. Tambahan pula, Joelle Pineau, salah seorang ketua AI Meta, dikatakan meletak jawatan Mei 2025.

| Model | Active Parameters | Total Parameters | Experts | Context Window | Training Tokens | ELO (LMArena) |

|---|---|---|---|---|---|---|

| Llama 4 Scout | 17B | 109B | 16 | 10M | ~40T | 1417 |

| Llama 4 Maverick | 17B | 400B | 128 | 1M | ~22T | 1417 |

| Llama 4 Behemoth | 288B | 2T | 16 | N/A | N/A | N/A |

✅ DeepSeek V3 dilatih hanya $5.5M tapi lebih baik dari Llama 4 dalam reasoning.

✅ “Llama 4 will probably suck” – 308 upvotes di Reddit.

✅ Jangan hanya tengok spec atas kertas – uji sendiri.

✅ Sesuai untuk tugasan long context, multimodal, text + image, bukan coding.

✅ Ambil kira kos hardware dan deployment.

✅ Buat perbandingan telus dengan pesaing seperti QwQ-32b, Gemini 2.5 Pro.

Llama 4 memang hebat dari segi reka bentuk dan skala, tapi jangan tertipu dengan angka besar. Prestasinya tidak semestinya mencerminkan real-world usage. Sama ada anda penulis blog, developer, atau peminat AI, kuncinya adalah: uji dulu, nilai dengan objektif. Jangan jadi mangsa hype!