Sri Rampai, Wangsa Maju

Kuala Lumpur, Malaysia

adyaakob@gmail.com

+60 102369037

Sri Rampai, Wangsa Maju

Kuala Lumpur, Malaysia

adyaakob@gmail.com

+60 102369037

Pernah tak masa tanya soalan dekat AI macam ChatGPT atau Google, dia terus bagi jawapan satu baris je?

Contohnya:

“Macam mana nak kira zakat pendapatan?”

Jawapan:

“2.5% dari pendapatan.”

Habis tu, nak kira dari gaji kasar ke bersih? Tolak hutang? Masuk KWSP sekali?

Kita jadi lagi pening lepas baca jawapan tu.

Apa masalahnya? AI tahu jawapan, tapi tak tunjuk macam mana dia fikir. Kita manusia pula suka tengok jalan kira, sebab dari situlah kita faham konsep.

Dalam banyak kes — pendidikan, perundangan, pelaburan, hal agama — jawapan ringkas tanpa penjelasan boleh jadi bahaya. Bila AI “main agak”, kita yang tanggung akibatnya.

Masalah utamanya?

✅ AI tak tunjuk proses fikir

✅ AI tak faham konteks tempatan

✅ AI tak mampu “bercerita” macam manusia

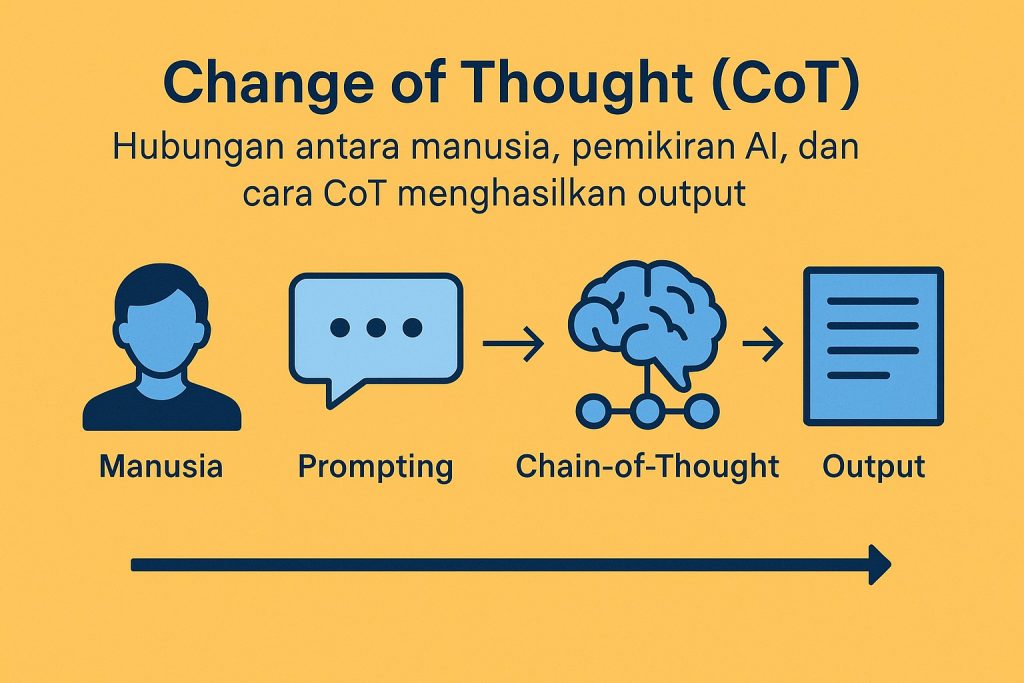

Apa itu CoT?

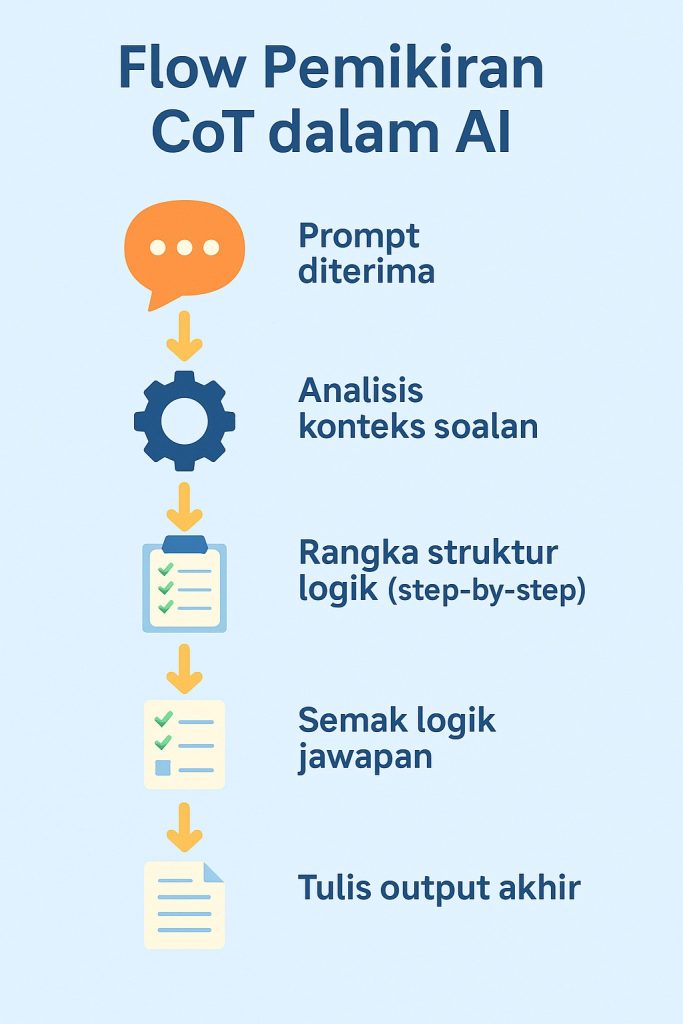

Change of Thought (CoT) atau dalam bahasa teknikal, Chain-of-Thought Prompting, ialah teknik yang latih AI untuk fikir satu demi satu langkah, macam cikgu ajar murid.

Contoh CoT:

“Ali ada 3 epal. Dia beli 2 lagi. Berapa jumlah?”

Jawapan AI (dengan CoT):

“Ali ada 3 epal. Tambah 2 jadi 5. Jawapan: 5 epal.”

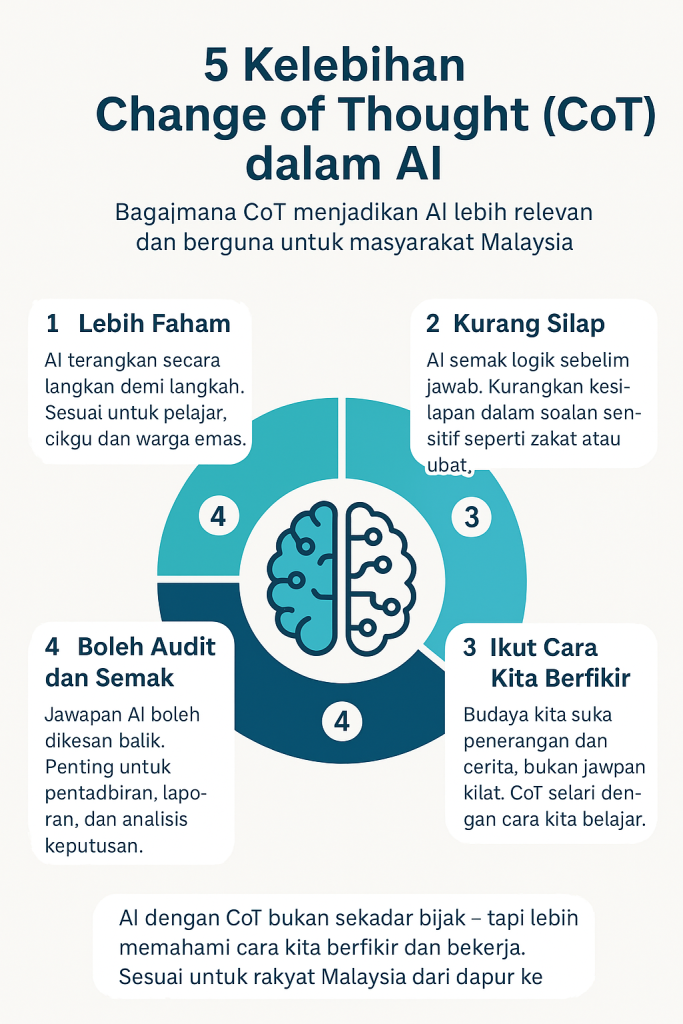

| Sebab | Penjelasan Ringkas |

|---|---|

| Faham Konteks | AI tak sekadar jawab, tapi jelaskan proses. |

| Kurang Silap | Bila AI fikir langkah-langkah, dia kurang buat kesilapan logik. |

| Lebih Mesra Pengguna | AI jadi lebih senang difahami oleh pelajar, orang awam, dan warga emas. |

| Boleh Audit Jawapan | Kita boleh semak balik kenapa AI pilih sesuatu keputusan. |

✅ Pelajar tak faham Matematik walau tahu jawapan

✅ AI tunjuk jalan kerja satu persatu

✅ Zakat, hibah dan faraid sering disalahfaham

✅ AI analisis mengikut konteks dan mazhab

✅ EA buka posisi tapi tak tahu kenapa

✅ AI jelaskan SMC setup → confirm → entry

✅ AI cadang ubat tanpa sebab

✅ AI tunjuk simptom → kemungkinan → diagnosis

✅ Rakyat keliru dengan syarat bantuan

✅ AI susun kelayakan satu demi satu: dokumen, pendapatan, status

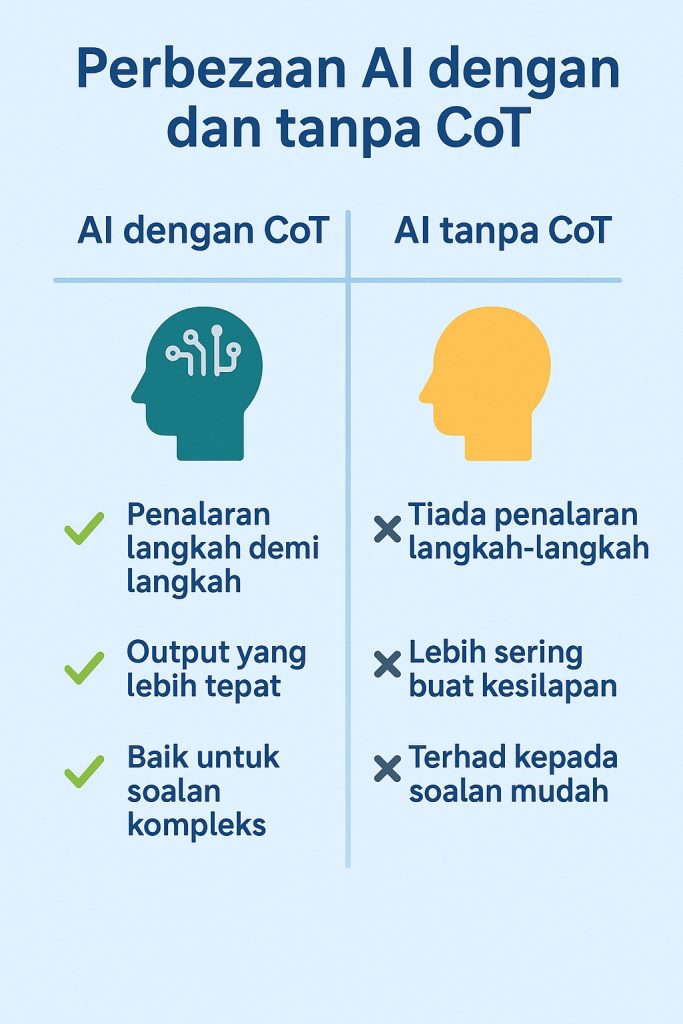

| Soalan | AI Biasa | AI dengan CoT |

| “Berapa 3.5% dari RM15,000?” | “RM525” | “Langkah: (3.5 ÷ 100) × 15,000 = RM525” |

| “Apa hukum pelaburan ASB?” | “Harus” | “Langkah: Tiada riba → ASNB patuh syariah → Maka harus” |

| “Kenapa saya tak layak bantuan STR?” | “Anda tidak layak” | “Langkah: Gaji melebihi RM2,500 → Tiada tanggungan → Maka tidak layak” |

Kita orang Malaysia sangat berbudaya “penerangan”.

Contohnya:

✅ Resepi masak rendang: “Tumis dulu bawang, baru masuk santan.”

✅ Ajar anak: “Jangan lintas jalan tanpa tengok kiri kanan.”

✅ Bila orang tanya soalan: “Okay, meh abang cerita dari mula…”

CoT ialah cara kita masukkan gaya kita berfikir ke dalam AI.

Cuba tambah arahan berikut dalam soalan anda:

✅ “Boleh terangkan langkah demi langkah?”

✅ “Jangan bagi jawapan terus, cerita dulu logik dia.”

✅ “Bayangkan anda cikgu ajar murid.”

Contoh:

“Saya ada RM2,000. Kalau labur dalam ASB, berapa saya dapat lepas setahun?

Sila tunjuk langkah kira dan logik keputusan.”

Teknologi makin maju, tapi kalau AI masih jawab macam kalkulator, kita masih tertinggal.

CoT bukan sekadar buat AI nampak pintar. Ia jadikan AI mesra budaya, mesra manusia, dan mesra Malaysia.

Ajar AI untuk bukan sekadar tahu — tapi faham cara kita fikir.